在科技巨頭亞馬遜云科技(AWS)的最新動作中,一項旨在解決AI模型產生幻覺問題的新工具正式亮相。這一消息在AWS于拉斯維加斯舉辦的re:Invent 2024大會上發布,引起了業界的廣泛關注。

AWS推出的這款名為“自動推理檢查”的工具,其工作原理是通過交叉引用客戶提供的信息來驗證AI模型生成的響應是否準確。AWS自信地宣稱,這是首個也是唯一一個專門針對AI幻覺問題的防護措施。然而,這一說法并非毫無爭議。事實上,微軟在今年早些時候推出的“校正”功能與“自動推理檢查”有著異曲同工之妙,都能標記出AI生成文本中可能存在的事實錯誤。谷歌的Vertex AI平臺也提供了一個類似工具,允許客戶利用第三方數據、自有數據集或谷歌搜索來增強模型回答的可靠性。

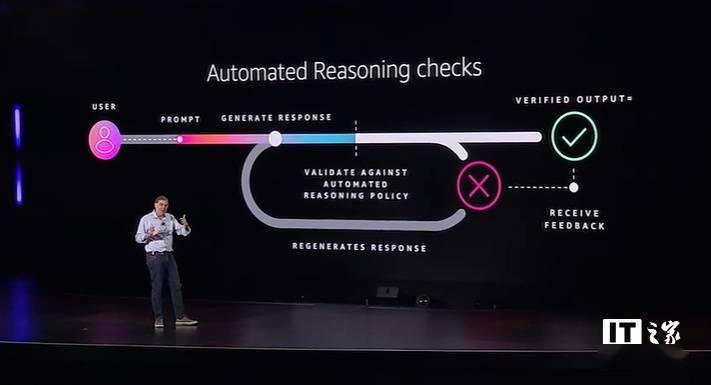

“自動推理檢查”依托AWS的Bedrock模型托管服務中的Guardrails工具,致力于探究模型得出答案的過程,并判斷其準確性。客戶可以上傳信息以建立事實基礎,隨后“自動推理檢查”會根據這些信息創建規則,這些規則經過優化后應用于模型。當模型生成回答時,“自動推理檢查”會對其進行驗證,一旦發現幻覺問題,便利用事實基礎得出正確答案,并與可能的錯誤答案一同呈現給客戶,以便他們了解模型偏離正確答案的程度。

AWS透露,普華永道已經率先采用“自動推理檢查”為其客戶設計AI助手,這一消息進一步證明了該工具的市場潛力。AWS的AI和數據副總裁Swami Sivasubramanian也暗示,正是這類工具吸引了客戶選擇Bedrock。然而,盡管AWS對“自動推理檢查”寄予厚望,但并非所有人都對其持樂觀態度。有專家指出,試圖消除生成式AI的幻覺無異于從水中消除氫,因為AI模型本質上并不“知道”任何事情,它們只是基于統計系統的預測工具,通過識別數據模式來預測下一個數據點,因此模型的響應只是在一定誤差范圍內的預測,而非確切答案。

AWS聲稱,“自動推理檢查”利用“邏輯準確”和“可驗證的推理”來得出結論,但遺憾的是,該公司并未提供任何數據來支持這一工具的可靠性。盡管如此,隨著AI技術的不斷發展和普及,如何有效解決AI模型的幻覺問題仍將是業界持續關注的焦點。