OpenAI近日在人工智能技術(shù)領(lǐng)域邁出了重要一步,于3月20日正式宣布推出全新的語(yǔ)音轉(zhuǎn)文本(speech-to-text)及文本轉(zhuǎn)語(yǔ)音(text-to-speech)模型,旨在顯著提升語(yǔ)音處理能力,并為開(kāi)發(fā)者提供更加精確、高度可定制的語(yǔ)音交互系統(tǒng)解決方案。這一舉措預(yù)示著人工智能語(yǔ)音技術(shù)商業(yè)化應(yīng)用的進(jìn)一步加速。

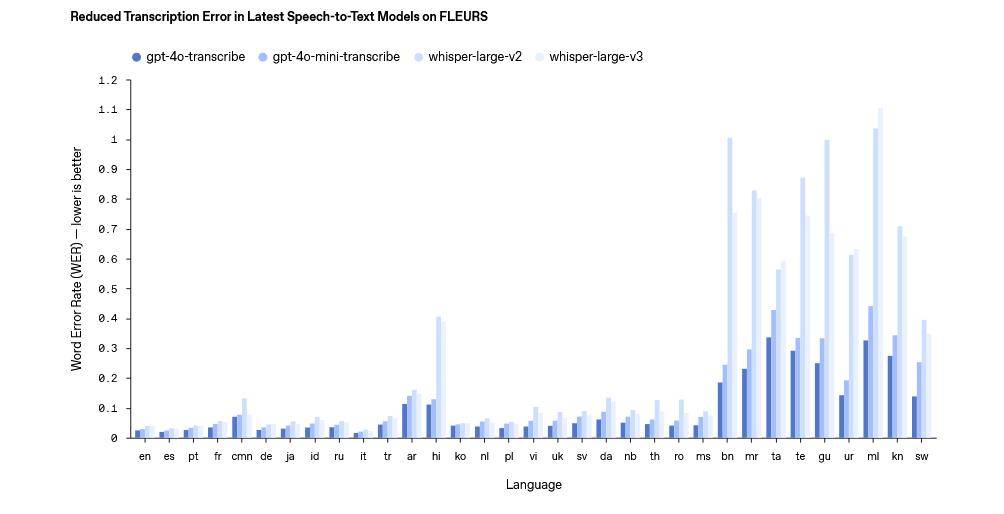

在語(yǔ)音轉(zhuǎn)文本領(lǐng)域,OpenAI推出了gpt-4o-transcribe和gpt-4o-mini-transcribe兩款模型,據(jù)官方宣稱,這兩款模型在單詞錯(cuò)誤率(WER)、語(yǔ)言識(shí)別精度以及整體準(zhǔn)確性方面,均超越了其現(xiàn)有的Whisper系列模型。它們能夠支持超過(guò)100種語(yǔ)言,通過(guò)強(qiáng)化學(xué)習(xí)和多樣化高質(zhì)量音頻數(shù)據(jù)集的深入訓(xùn)練,成功捕捉語(yǔ)音中的細(xì)微特征,有效減少誤識(shí)別情況,特別是在嘈雜環(huán)境、不同口音及語(yǔ)速變化下,展現(xiàn)出更加穩(wěn)定的性能。

這兩款新模型的問(wèn)世,無(wú)疑為開(kāi)發(fā)者提供了更為強(qiáng)大的工具,使他們能夠構(gòu)建出更加精準(zhǔn)、適應(yīng)性更強(qiáng)的語(yǔ)音交互系統(tǒng),滿足不同場(chǎng)景下的需求。無(wú)論是智能客服、智能家居,還是自動(dòng)駕駛等領(lǐng)域,都將因此受益。

在文本轉(zhuǎn)語(yǔ)音方面,OpenAI同樣推出了創(chuàng)新的gpt-4o-mini-tts模型。這款模型允許開(kāi)發(fā)者通過(guò)簡(jiǎn)單的指令,如“模擬耐心客服”或“生動(dòng)故事敘述”,來(lái)控制語(yǔ)音的風(fēng)格和語(yǔ)調(diào)。這一特性使得gpt-4o-mini-tts在客服領(lǐng)域具有巨大潛力,能夠合成更具同理心的語(yǔ)音,從而顯著提升用戶體驗(yàn)。同時(shí),它也為創(chuàng)意內(nèi)容制作帶來(lái)了無(wú)限可能,如有聲書(shū)錄制、游戲角色配音等。

為了幫助開(kāi)發(fā)者更好地了解和使用這些新模型,OpenAI還公布了詳細(xì)的費(fèi)用說(shuō)明。gpt-4o-transcribe模型在處理音頻輸入時(shí),每100萬(wàn)tokens的費(fèi)用為6美元,文本輸入和輸出的費(fèi)用分別為2.5美元和10美元,每分鐘的成本為0.6美分。相比之下,gpt-4o-mini-transcribe模型的費(fèi)用更加親民,音頻輸入、文本輸入和輸出的費(fèi)用分別為3美元、1.25美元和5美元,每分鐘的成本僅為0.3美分。而gpt-4o-mini-tts模型則按輸入和輸出分別計(jì)費(fèi),每100萬(wàn)tokens的輸入費(fèi)用為0.6美元,輸出費(fèi)用為12美元,每分鐘的成本為1.5美分。

OpenAI此次推出的新模型,不僅展示了其在人工智能技術(shù)領(lǐng)域的深厚積累和創(chuàng)新實(shí)力,也為整個(gè)行業(yè)樹(shù)立了新的標(biāo)桿。隨著這些模型的不斷優(yōu)化和推廣,人工智能語(yǔ)音技術(shù)將在更多領(lǐng)域發(fā)揮重要作用,推動(dòng)社會(huì)進(jìn)步和產(chǎn)業(yè)發(fā)展。