近期,人工智能領域迎來了一項引人注目的新突破。據一份最新發布的研究報告顯示,斯坦福大學與華盛頓大學的科研團隊,僅憑不到50美元的云計算成本(當前匯率下約364元人民幣),就成功打造了一款具備卓越“推理”能力的人工智能模型——s1。

這款s1模型在數學與編程能力測試中,展現出了與OpenAI的o1、DeepSeek的r1等業界頂尖推理模型相媲美的水平。更令人矚目的是,s1模型及其訓練數據和代碼已在GitHub平臺上全面開源,供全球開發者研究和使用。

s1團隊揭秘,他們采用了“蒸餾”技術來創建這款模型。該技術通過訓練模型來學習另一個AI模型的答案,從而提煉出其核心推理能力。據悉,s1模型是從谷歌的Gemini 2.0 Flash Thinking Experimental模型中蒸餾而來。而就在上個月,加州大學伯克利分校的研究人員也運用相同的蒸餾方法,以約450美元的成本開發了一款AI推理模型。

隨著s1等類似模型的出現,人工智能領域的商品化問題日益凸顯。當有人能夠以極低的成本復制出價值數百萬美元的模型時,大型科技公司的競爭優勢何在?這一問題引發了業界的廣泛關注和討論。

面對這一挑戰,大型AI實驗室紛紛表達不滿。例如,OpenAI就曾指責DeepSeek不當獲取其API數據用于模型蒸餾。而s1團隊則致力于探索實現強大推理性能和“測試時擴展”的最簡潔途徑,這些正是OpenAI的o1模型所取得的突破。

s1的論文指出,通過監督微調(SFT)方法,可以使用較小的數據集來蒸餾推理模型。在SFT過程中,AI模型被明確指示在數據集中模仿特定行為。相較于DeepSeek用于訓練R1模型的大規模強化學習方法,SFT更具成本效益。

值得注意的是,谷歌通過其Google AI Studio平臺免費提供Gemini 2.0 Flash Thinking Experimental模型的訪問權限,但設有每日使用限制。然而,其使用條款明確禁止對模型進行逆向工程,以開發與谷歌自身AI產品競爭的服務。盡管如此,s1團隊還是巧妙地利用了這一資源。

s1模型基于阿里巴巴旗下中國人工智能實驗室Qwen提供的一款小型、現成的免費AI模型。為了訓練s1,研究人員精心策劃了一個包含1000個問題及其答案的數據集,并收集了谷歌Gemini 2.0 Flash Thinking Experimental對每個答案背后“思考”過程的輸出。

在訓練過程中,研究人員使用了16個Nvidia H100 GPU,耗時不到30分鐘,便成功訓練出了s1模型。據參與該項目的斯坦福大學研究員Niklas Muennighoff透露,目前租用這些計算資源的成本約為20美元。這一低廉的成本再次凸顯了s1模型的性價比優勢。

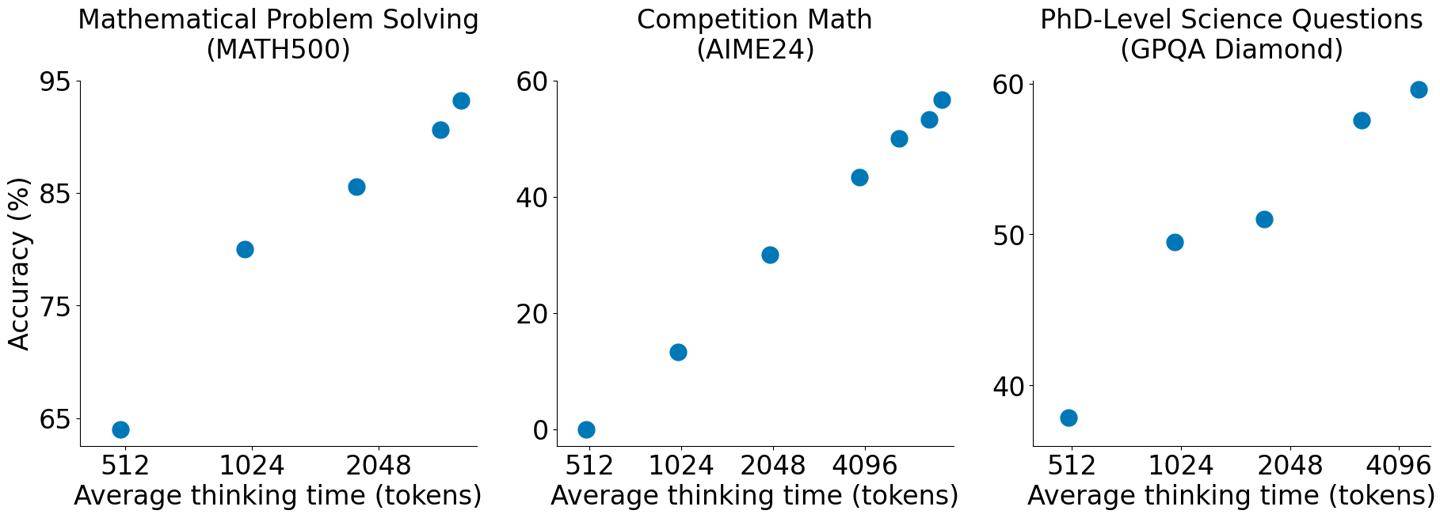

為了進一步提升s1的性能,研究人員還采用了一個巧妙的技巧:讓s1在推理過程中“等待”。論文顯示,在s1的推理步驟中添加“等待”一詞,有助于模型獲得更為準確的答案。這一發現為AI模型的優化提供了新的思路。