1 月 9 日消息,2020 年 6 月,在訓練約 2000 億個單詞、燒掉幾千萬美元后,史上最強大 AI 模型“生成型已訓練變換模型 3”(GPT-3)一炮而紅。

這個 OpenAI 打造的語言 AI 模型宛如萬能選手,只有你想不到的畫風,沒有它輸不出的文案,既能創作文學,能當翻譯,還能編寫自己的計算機代碼。任何外行人都可以使用這一模型,幾分鐘內提供示例,就能獲得想要的文本產出。

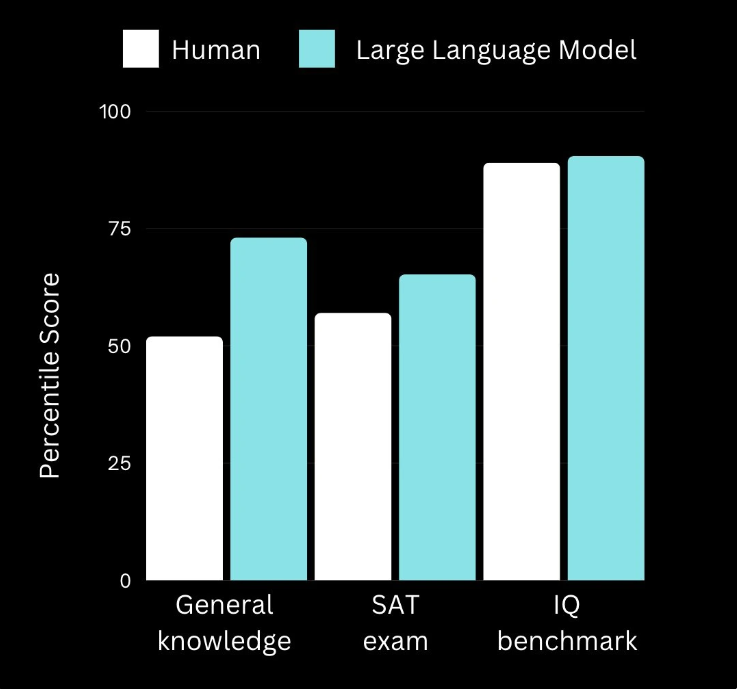

據新華社,美國加利福尼亞大學洛杉磯分校的研究人員發現,在衡量智力的一系列推理測試中,自回歸語言模型 GPT-3 的成績明顯優于普通大學生。

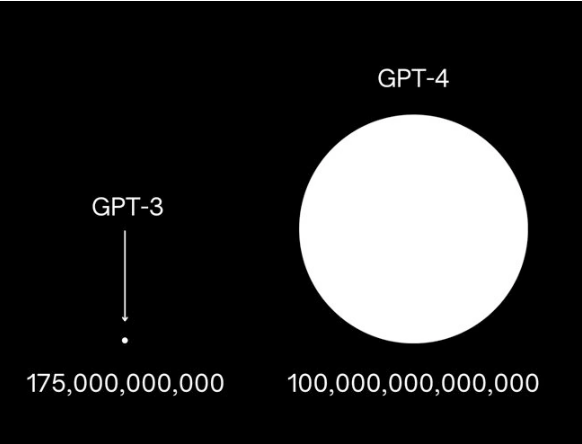

該程序利用深度學習生成類似人類語言的文本。GPT-3 有很多用途,包括語言翻譯和為聊天機器人生成文本等,其有 1750 億個參數,是目前規模最大、功能最強的語言處理人工智能模型之一。

這里突然想到,OpenAI 的 ChatGPT 似乎也實現了類似效果,雖然它依然基于 GGPT-3,但這一模型被業內稱為“GPT-4” ,這也是硅谷研究實驗室推出的第四代語言模型,對全世界的搜索引擎、作家、編碼人員、教授以及 Nickelback 構成了生存威脅。

當然,根據大多數專家的意見,與即將發布的 GPT-4 主版本相比,ChatGPT 現版本只能說是一個開胃小菜。

加州大學研究者認為,這類大型語言模型重新引發了關于在提供足夠訓練數據的情況下人類認知能力是否更強的爭論。特別令人感興趣的是這些模型能夠零樣本地推理新問題,而無需對這些問題進行任何直接訓練。

研究人員指出,在人類認知中,這種能力與類比推理能力密切相關,而他們在一系列類比任務上對 GPT-3 進行了直接比較,包括與 Raven 的漸進矩陣密切相關的新型基于文本的矩陣推理任務,最終發現 GPT-3 表現出了驚人的抽象模式歸納能力,在大多數情況下匹配甚至超越人類的能力。

最終結果表明,諸如 GPT-3 之類的大型語言模型已經獲得了一種“新興能力”,可以為廣泛的類比問題找到零樣本解決方案。